機器之心報道

作者:小舟

RUDN 大學的數(shù)學家團隊找到一種新方法,該方法能夠讓神經(jīng)網(wǎng)絡的大小減小到六分之一,且無需花費更多的資源重新訓練。

神經(jīng)網(wǎng)絡壓縮是指在對神經(jīng)網(wǎng)絡性能影響不大的情況下,通過有關(guān)方法來減少網(wǎng)絡的參數(shù)和存儲空間,大體上可以分為近似,量化和剪枝三類方法。

近日,來自俄羅斯人民友誼大學(RUDN)的數(shù)學家團隊找到一種方法,可以將訓練后的神經(jīng)網(wǎng)絡的大小減小六倍,而無需花費更多的資源來對其進行重新訓練。該方法基于找到初始系統(tǒng)及其簡化版本中神經(jīng)連接權(quán)重之間的相關(guān)性。這項研究的結(jié)果發(fā)表在《Optical Memory and Neural Networks》期刊上。

生命體中人工神經(jīng)網(wǎng)絡和神經(jīng)元的結(jié)構(gòu)是基于相同的原理。網(wǎng)絡中的節(jié)點是相互連接的;其中一些接收信號,一些通過激活或抑制鏈中的下一個元素來發(fā)送信號。任何信號(例如圖像或聲音)的處理都需要很多網(wǎng)絡元素及其之間的連接。但是,計算機模型只有有限的模型容量和存儲空間。為了處理大量數(shù)據(jù),這一領(lǐng)域的研究者必須發(fā)明各種方法來降低對模型能力的需求,包括所謂的量化。這有助于減少資源消耗,但需要對系統(tǒng)進行重新訓練。RUDN 大學的一些數(shù)學家發(fā)現(xiàn)后者可以避免。

RUDN 大學 Nikolskii 數(shù)學研究所助理教授 Iakov Karandashev 博士說:「幾年前,我們在 Hopfield 網(wǎng)絡中進行了有效且經(jīng)濟高效的權(quán)重量化。這是一個關(guān)聯(lián)存儲網(wǎng)絡,并帶有遵循 Hebb 規(guī)則形成的元素之間的對稱連接。在其運行過程中,網(wǎng)絡的活動被降低到某個平衡狀態(tài),并且在該狀態(tài)達到時任務就被認為是已經(jīng)解決了,該研究中獲得的見解后來被應用于當今在圖像識別中非常流行的前饋深度學習網(wǎng)絡。通常這些網(wǎng)絡需要在量化后進行重新訓練,而我們找到了避免重新訓練的方法。」

簡化人工神經(jīng)網(wǎng)絡背后的主要思想是所謂的權(quán)重量化,即減少每個權(quán)重的位數(shù)。量化提供信號的均值化:例如,如果將其應用于圖像,則代表相同顏色不同陰影的所有像素將變得相同。從數(shù)學上講,這意味著借助某些參數(shù)的相似神經(jīng)連接應該具有相同的權(quán)重(或重要性),即表示成同一個數(shù)字。

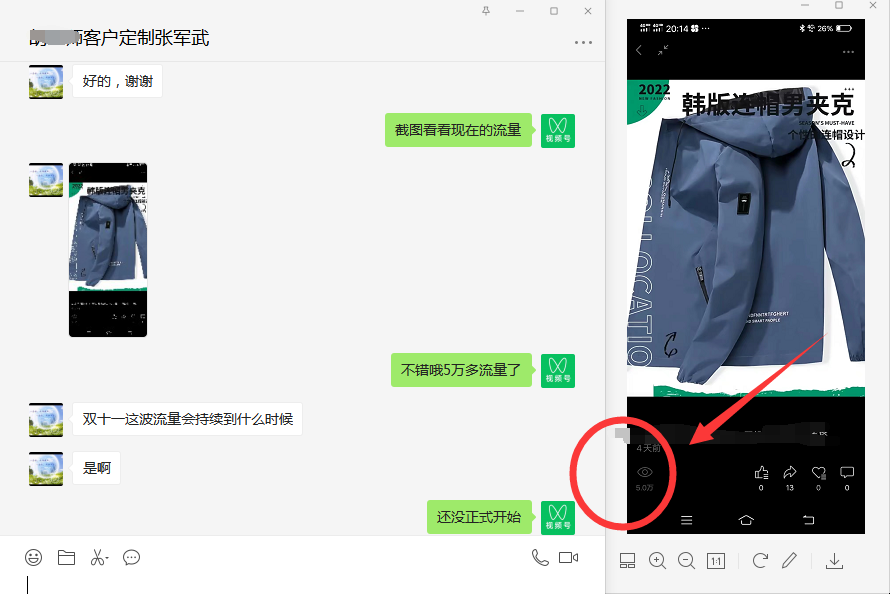

RUDN 大學的一個數(shù)學家團隊進行了計算并創(chuàng)建了公式,該公式可以有效地在量化前后,在神經(jīng)網(wǎng)絡的權(quán)重之間建立相關(guān)性。基于此,科學家們開發(fā)了一種算法,利用該算法,經(jīng)過訓練的神經(jīng)網(wǎng)絡可以對圖像進行分類。在該研究的實驗中,數(shù)學家使用了包含 5 萬張照片的數(shù)據(jù)集,這些照片包可以被分為 1000 組。訓練之后,該網(wǎng)絡會使用新方法進行量化,并且不進行重新訓練。然后,該研究將實驗結(jié)果與其他量化算法進行了比較。

RUDN 大學的 Iakov Karandashev 補充說道:「量化之后,分類準確率僅降低了 1%,但是所需的存儲容量減少了 6 倍。實驗表明,由于初始權(quán)重與量化后權(quán)重之間的相關(guān)性很強,該網(wǎng)絡不需要重新訓練。這種方法有助于在完成時間敏感任務或在移動設備上運行任務時節(jié)省資源。」

感興趣的讀者可以閱讀期刊原文。

參考原文:

https://www.eurekalert.org/pub_releases/2021-02/ru-rum020521.php

論文鏈接:

https://link.springer.com/article/10.3103/S1060992X20030042

https://arxiv.org/abs/2002.00623