最近看電視,小探開始感慨時(shí)光如水啊。怎么覺(jué)得巴西里約奧運(yùn)會(huì)才剛剛過(guò)去,日本奧運(yùn)會(huì)怎么就要來(lái)了呢?!

日本 NEC 公司近日宣布,2020 日本奧運(yùn)會(huì)將使用 NEC 旗下的人工智能 NeoFace 來(lái)進(jìn)行大范圍的人臉識(shí)別功能。據(jù)悉,該系統(tǒng)會(huì)被用在三十多萬(wàn)人身上,包括運(yùn)動(dòng)員、志愿者、觀眾、媒體等參會(huì)者。據(jù)說(shuō),NEC 目前的人臉識(shí)別技術(shù)已經(jīng)通過(guò)了美國(guó)國(guó)家標(biāo)準(zhǔn)與技術(shù)研究所的基準(zhǔn)測(cè)試,目前處于世界前列。

可是小探我怎么看到了張學(xué)友不懷好意的笑了呢?

我們都知道張學(xué)友是歌神,但其實(shí)他是一位被歌神耽誤了的 “捕神” … 今年早些時(shí)候,在自己的四場(chǎng)音樂(lè)會(huì)上,“協(xié)警” 張學(xué)友一共幫警方抓住了五名在逃嫌疑犯!這可真是 “你來(lái)聽我的演唱會(huì),附贈(zèng)手銬一對(duì)。”

作為人臉識(shí)別技術(shù)的鼻祖 —— 圖像識(shí)別技術(shù),大家又了解多少?目前已經(jīng)發(fā)展到什么階段?接下來(lái)還會(huì)不會(huì)有新的突破呢?

今天,小探就帶領(lǐng)大家一起去看看關(guān)于圖像識(shí)別技術(shù)的發(fā)展。

AI 圖像識(shí)別到底是個(gè)啥?

圖像識(shí)別技術(shù)是以圖像的主要特征為基礎(chǔ)的。比如說(shuō),如花,你要抓住她那張嘴和鼻孔。

因?yàn)檠芯咳藛T發(fā)現(xiàn),當(dāng)人類在看圖像時(shí),視線總會(huì)集中在主要特征上,也就是在圖像輪廓曲度最大或輪廓方向突然改變的地方。

這些地方的信息量最大。而且眼睛的掃描路線也總是依次從一個(gè)特征轉(zhuǎn)到另一個(gè)特征上。同時(shí),在大腦里有一個(gè)機(jī)制負(fù)責(zé)整合信息,把分階段獲得的信息整理完整。

圖像識(shí)別技術(shù)在各行業(yè)中具有廣泛應(yīng)用。谷歌的 TensorFlow、Facebook 的 DeepFace、微軟的 Project Oxford 都是深度學(xué)習(xí)圖像識(shí)別系統(tǒng)的例子。據(jù)KBV Research 數(shù)據(jù)預(yù)測(cè),到2022年,全球圖像識(shí)別市場(chǎng)將高達(dá) 422 億美元!

圖像識(shí)別的技術(shù),從一開始,就和人工智能緊緊地聯(lián)系在了一起。

而

今年一月,谷歌發(fā)布了一款新的人工智能工具,讓任何人都可以在他們選擇的照片數(shù)據(jù)集上訓(xùn)練機(jī)器學(xué)習(xí)系統(tǒng)。該軟件稱為 Cloud AutoML Vision。在隨后的博客文章中,Google Cloud AI 部門的首席科學(xué)家解釋了該軟件如何幫助沒(méi)有機(jī)器學(xué)習(xí)背景的用戶。

除了商業(yè)目的的炒作,訓(xùn)練 AI 看起來(lái)似乎非常簡(jiǎn)單。

首先,你需要大量的標(biāo)記圖像。最小數(shù)量值為 20 個(gè)標(biāo)記,軟件最多支持?jǐn)?shù)量值 10,000個(gè)標(biāo)記。標(biāo)記越多,辨識(shí)度也就越高。

很多圖像識(shí)別都是關(guān)于識(shí)別模式。一旦Google的AI認(rèn)為它很好地理解了用戶上傳的圖像的鏈接,它就可以用來(lái)在新的上傳中查找該模式,然后吐出一個(gè)數(shù)字,表示它認(rèn)為新圖像匹配它的程度。因此,氣象學(xué)家們可以利用此技術(shù)在天氣變化時(shí)上傳圖像,識(shí)別云、雨、霧、霜等,并同時(shí)繼續(xù)訓(xùn)練和改進(jìn)軟件。

說(shuō)起訓(xùn)練和改進(jìn)軟件,斯坦福教授李飛飛的團(tuán)隊(duì)去年曾經(jīng)對(duì)圖像識(shí)別的發(fā)展歷程發(fā)表了一次演講。在演講中,李教授提到了早在 1996 年時(shí),神經(jīng)學(xué)家 Simon Thorpe 及團(tuán)隊(duì)就發(fā)布了一項(xiàng)研究,通過(guò)腦電波來(lái)觀察人腦對(duì)于圖像識(shí)別的速度。

僅僅用 100 微秒,也就是0.000001秒,大腦就會(huì)發(fā)出一道區(qū)分信號(hào),對(duì)畫面中的物體是否為動(dòng)物做出判斷。對(duì)于復(fù)雜目標(biāo)對(duì)象的處理能力,構(gòu)成了人類視覺(jué)系統(tǒng)的基礎(chǔ)。這項(xiàng)對(duì)目標(biāo)物體識(shí)別的研究,促進(jìn)了整個(gè)計(jì)算機(jī)視覺(jué)的大發(fā)展。

而李飛飛教授當(dāng)年所帶領(lǐng)的團(tuán)隊(duì)所做的ImageNet則是從2010年開始挑戰(zhàn)傳統(tǒng)的圖像分類,他們將識(shí)別錯(cuò)誤率從 28% 降低到了 2.3%。可謂成就矚目!

目前,AI 圖像識(shí)別的雖然可以識(shí)物,但是科學(xué)家們真正關(guān)心的是如何訓(xùn)練出可以識(shí)別物與物關(guān)系的系統(tǒng)。

然而

在李飛飛的演講中,她提到了,目前大家可以在谷歌中輸入“男人穿套裝”或者“可愛的狗狗”這一類的詞后,系統(tǒng)會(huì)返回給你漂亮的照片。

但當(dāng)我們用更復(fù)雜的句子搜圖時(shí),比如搜 “一個(gè)穿著紅衣服的小女孩在和一個(gè)穿著藍(lán)衣服的小男孩在海邊踢足球”,就很難搜出符合我們要求的圖片了。這是為什么呢?

李飛飛提到,“我們希望對(duì)我們得到的東西有更多的控制,更豐富的場(chǎng)景檢索。然后,場(chǎng)景檢索模型就沒(méi)法實(shí)現(xiàn)了,因?yàn)樗腔趯?duì)象的,它并不真正地理解關(guān)系。”

這也是目前圖片識(shí)別一直想要突破的問(wèn)題。

AI圖像識(shí)別 2.0 要來(lái)了?

然而,在硅谷就有這樣一支團(tuán)隊(duì),致力于解決關(guān)系型圖片搜索的問(wèn)題!小探最近采訪了 Neuron Drop 的創(chuàng)始人及 CEO Gordon Lu,請(qǐng)他來(lái)講一講 Neuron Drop 所做的開啟了 AI 2.0 時(shí)代的項(xiàng)目。據(jù) Gordon 介紹,他們的團(tuán)隊(duì)也有一批李飛飛級(jí)別的教授和工程師。

Gordon 認(rèn)為:如果說(shuō) AI 1.0 時(shí)代是目前李飛飛等科學(xué)家已經(jīng)形成的由深度學(xué)習(xí)構(gòu)建而成的“辨識(shí)物體”圖像識(shí)別技術(shù),那么 AI 2.0 則是涉及到了“辨識(shí)物體間關(guān)系” 的圖像識(shí)別技術(shù)。

Neuron Drop 是一家總部位于美國(guó)硅谷的AI 2.0神經(jīng)網(wǎng)絡(luò)公司,專注于動(dòng)態(tài)視覺(jué)識(shí)別技術(shù)。核心是軟件和芯片的開發(fā)能力 ,可賦于機(jī)器識(shí)別、追蹤、監(jiān)控動(dòng)態(tài)物體(如珍稀動(dòng)物、植物等)的能力 。公司的核心能力得到若干優(yōu)質(zhì)歷史項(xiàng)目的驗(yàn)證,如國(guó)防系統(tǒng), 駕駛技術(shù)等。現(xiàn)階段隨著模型的完善,將進(jìn)一步把核心技術(shù)民用化、消費(fèi)化。

Neuron Drop 首創(chuàng)了分布式智能深度學(xué)習(xí)算法 DCNN。這個(gè)算法有哪些特點(diǎn)呢?具體來(lái)看,首先,作為創(chuàng)始人的Gordon強(qiáng)調(diào)了“我們不是所有的情況下都需要用海量數(shù)據(jù)去學(xué)習(xí)”!

這個(gè)怎么講?原來(lái),Gordon和他的團(tuán)隊(duì)研發(fā)的 DCNN 算法相比較與傳統(tǒng)的 CNN (卷積神經(jīng)網(wǎng)絡(luò))模式,可以實(shí)現(xiàn)自我學(xué)習(xí),無(wú)需海量數(shù)據(jù)來(lái)構(gòu)建模型。

并且這其中的每一種算法的背后都有自己的 “指紋”。這是由于 Neuron Drop 原創(chuàng)的智能視覺(jué)能夠識(shí)別、跟蹤、預(yù)警深度學(xué)習(xí)模式。所以智能終端不需要重新學(xué)習(xí)。相比于其他人工智能模式可以大幅降低人工智能訓(xùn)練成本。

比如說(shuō),達(dá)芬奇的世界名畫《蒙娜麗莎》真品只有一幅。那么我們?cè)趺磥?lái)通過(guò)人工智能來(lái)辨識(shí)真跡?Gordon 強(qiáng)調(diào)了Neuron Drop 算法的獨(dú)特性,使得即使沒(méi)有數(shù)據(jù),人工智能也能做到“火眼金睛”。

“這也是我們和市場(chǎng)上李飛飛、吳恩達(dá)等人的研究的本質(zhì)不同所在。這就是我們的AI 2.0 版本。” Gordon 說(shuō)道。

同時(shí),Neuron Drop 基于動(dòng)態(tài)物體和人的行為特征構(gòu)建模型,相較傳統(tǒng)靜態(tài)識(shí)別可大幅度提高識(shí)別精確度。也就是說(shuō),有些東西在靜止的情況下不容易看出來(lái)是什么,但如果在動(dòng)態(tài)情況下,識(shí)別起來(lái)反而容易得多。

“在我們的測(cè)試環(huán)境下,我們發(fā)現(xiàn)我們的精準(zhǔn)度大概是97.7%-98.5%左右。” Gordon 補(bǔ)充到。

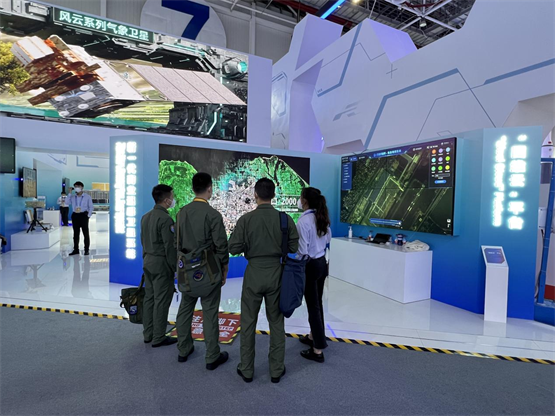

目前,Neuron Drop 目前主要針對(duì)中國(guó)市場(chǎng)。應(yīng)用場(chǎng)景包括大型國(guó)際會(huì)議、音樂(lè)會(huì)的安防,以及人口密集地區(qū)的活動(dòng)。

同時(shí),國(guó)內(nèi)的高鐵和高壓線維修保護(hù),Neuron Drop也能幫上忙!比如說(shuō),我們目前的高壓線維修都是需要人力爬到半空中檢查。而有了新的圖像識(shí)別技術(shù),只需要AI來(lái)通過(guò)拍照來(lái)檢測(cè)一下圖像上是否有異樣,便可以省去很多人力物力。

高鐵的軌道也是一樣道理。目前,國(guó)內(nèi)高鐵的第一班列車都會(huì)是空車運(yùn)行。目的就是要保證當(dāng)日鐵軌的足夠安全。如果人工智能夠直接識(shí)別有異樣的高鐵軌道,那么就不需要再耗時(shí)耗力地空跑第一趟高鐵了!

在采訪的最后,Gordon 透露,“谷歌去年的文字(搜索圖片)銷售的銷售額達(dá)到 1170 億美金,我們估計(jì)再過(guò)兩年,這個(gè)市場(chǎng)可以達(dá)到百億!

那么項(xiàng)目什么時(shí)候能投入使用呢?據(jù) Gordon介紹,今年年末國(guó)內(nèi)就有望使用該技術(shù)了!

可以想象,圖像識(shí)別2.0 的時(shí)代,不僅在識(shí)別辨識(shí)度上大幅度提高,很多人力、物力資源都會(huì)因此而被節(jié)省。那么圖像識(shí)別2.0 時(shí)代何時(shí)才能真正到來(lái)呢?我們翹首以待。